Docker安装 Open WebUI,调用API使用满血 DeepSeek R1+推理+联网

现在最火的AI模型是什么?当之无愧的肯定是DeepSeek,我今天也来凑这个热闹。废话不多说直接上干货!!

如果是NAS就在 Docker 镜像里直接搜索dyrnq/open-webui这个 Open WebUI 的镜像运行。

如果使用的是其他设备的Docker就直接用docker命令拉取(当然NAS也可以),我用的端口是3889

docker run -d -p 3889:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always dyrnq/open-webui:main

大厂的 API 基本都是注册就送 50 万、100 万,个人使用足够:

阿里云百炼(赠送 100 万 token)

火山方舟(赠送 50 万 token)

腾讯云(赠送 50 万 token)

硅基流动(赠送额度的不能用于满血 R1)

DeepSeek 官方(赠送 10 元额度)

注册就不说了,我拿我现在用的火山方舟来做示例

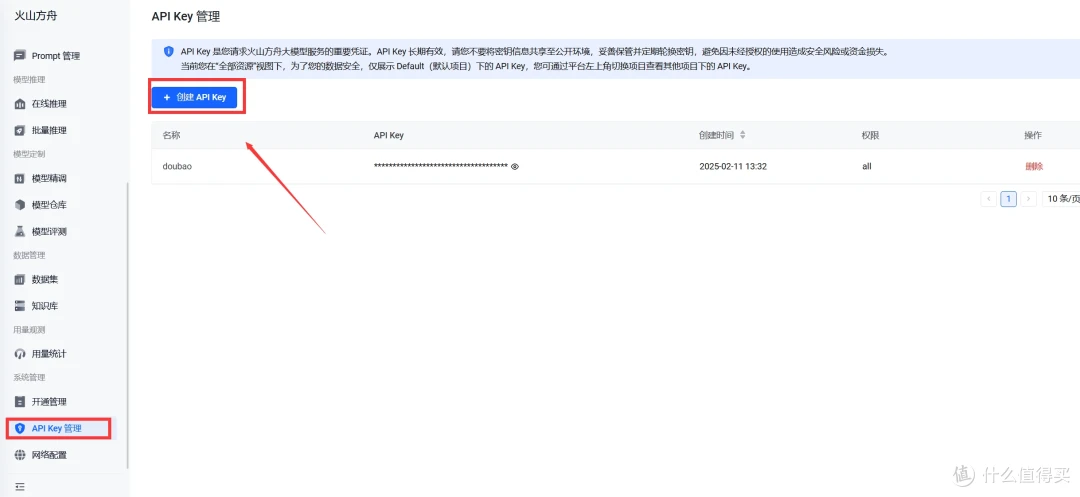

创建API,把API复制到记事本,后面要用到

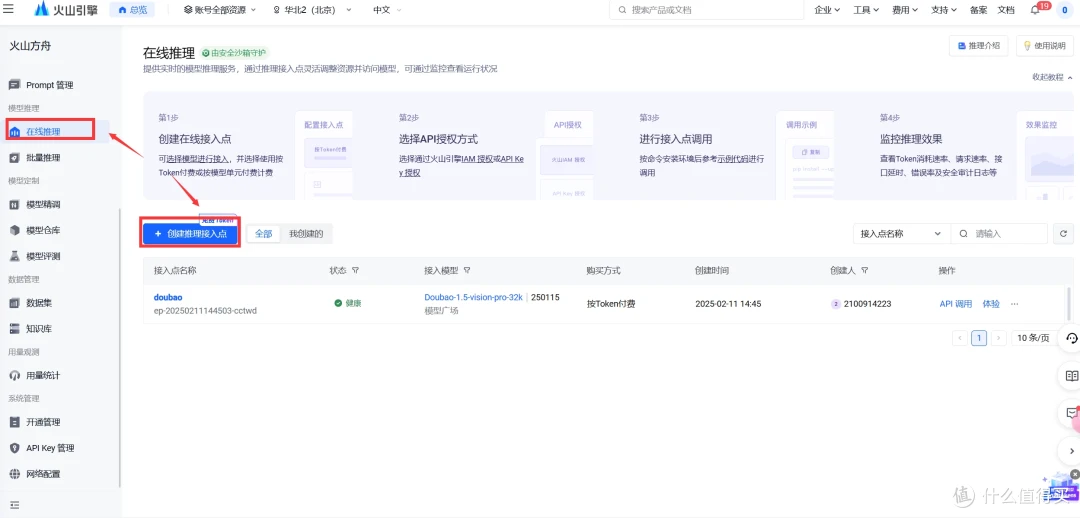

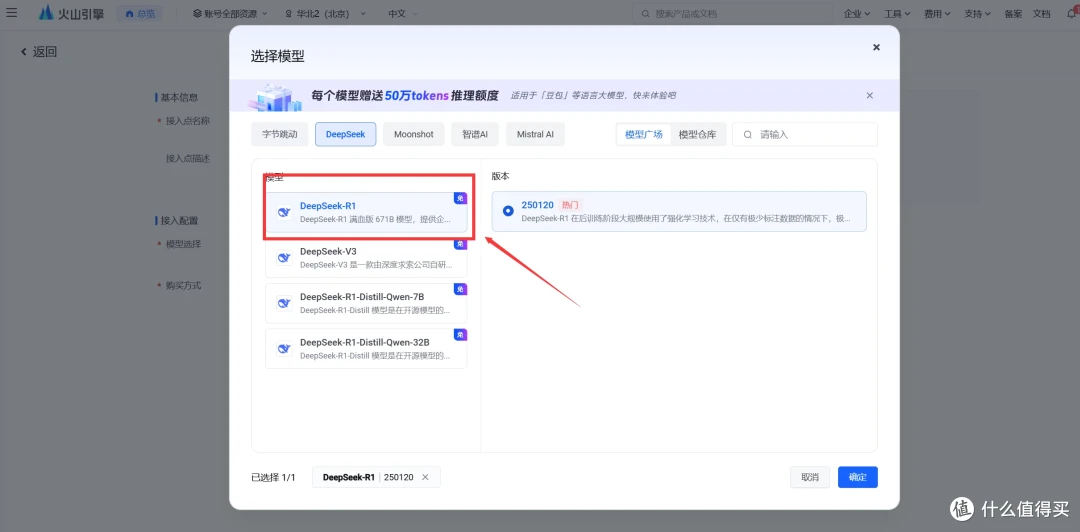

在线推理选择deepseek

然后就可以调用API了,三个参数分别是

API Key:复制出来的 API Key

模型:看下面的截图

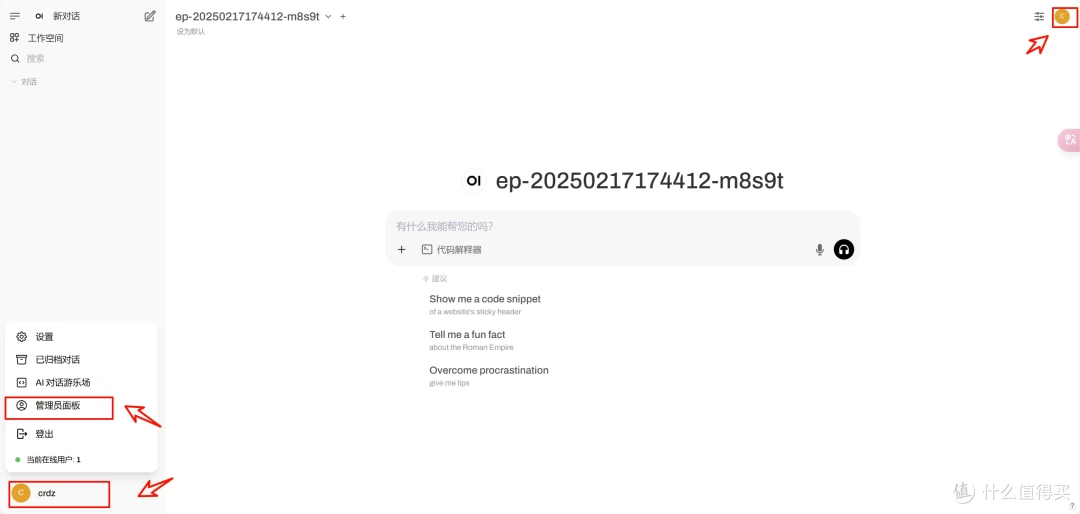

回到OpenWebUI然后填写相关参数,左下角或者右下角点击管理员面板

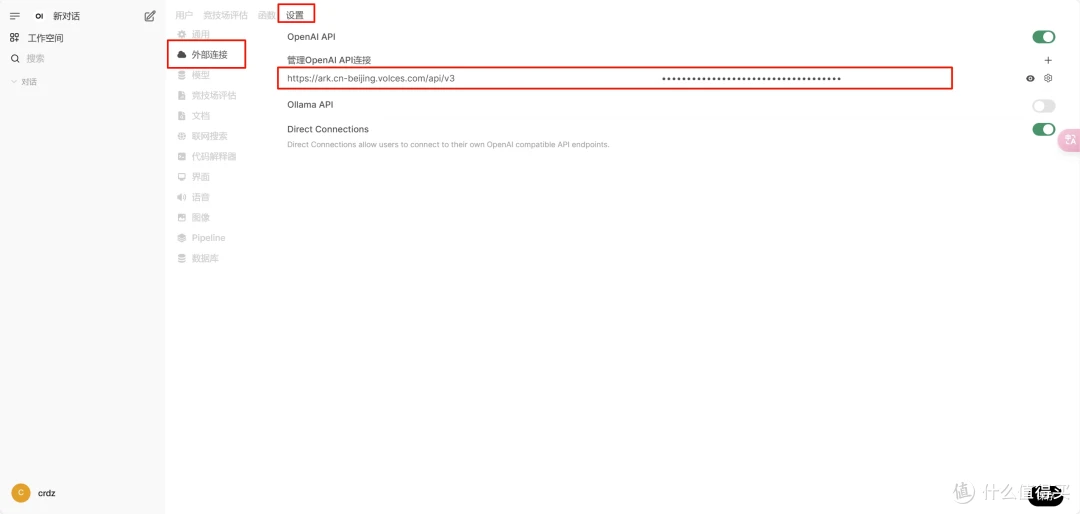

点设置-外部链接,填写URL和API KEY

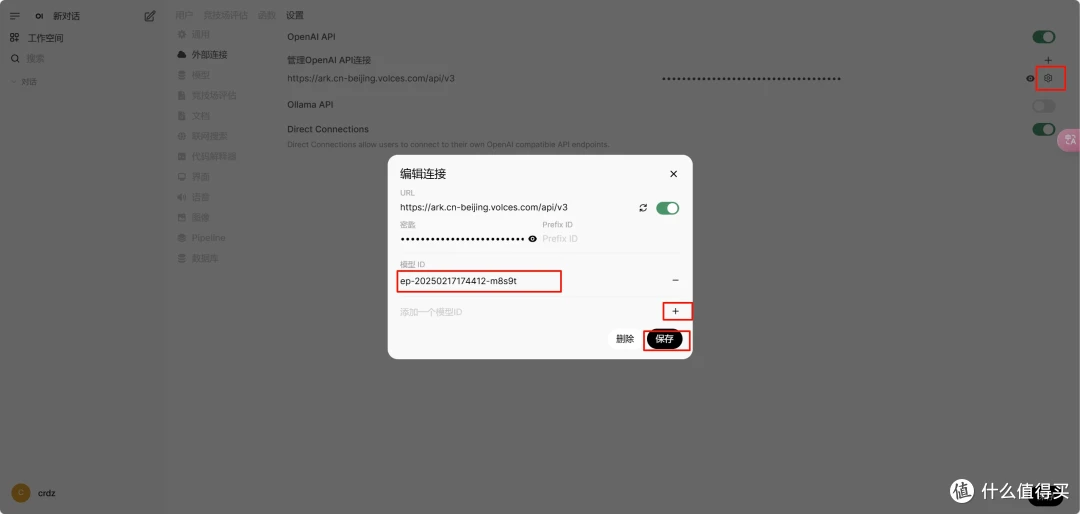

然后点击旁边的设置按钮添加模型

添加完模型以后一定要点击+号然后再点击保存,否则保存不了模型。

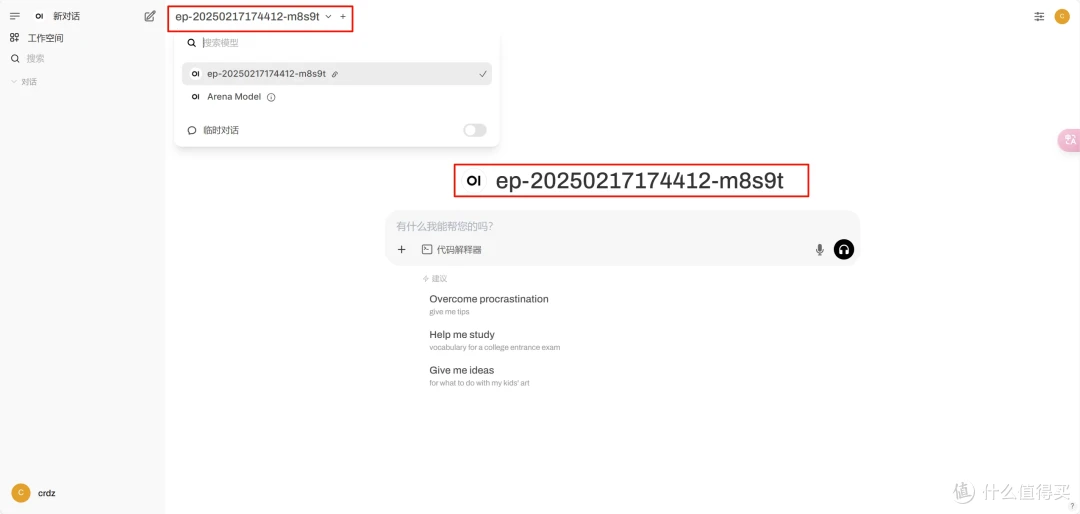

现在就可以愉快的聊天了

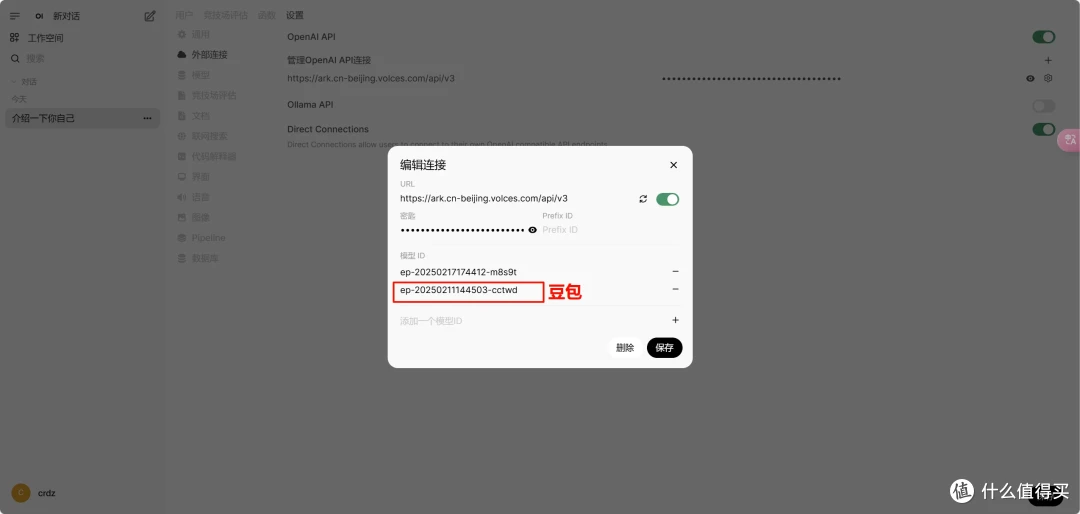

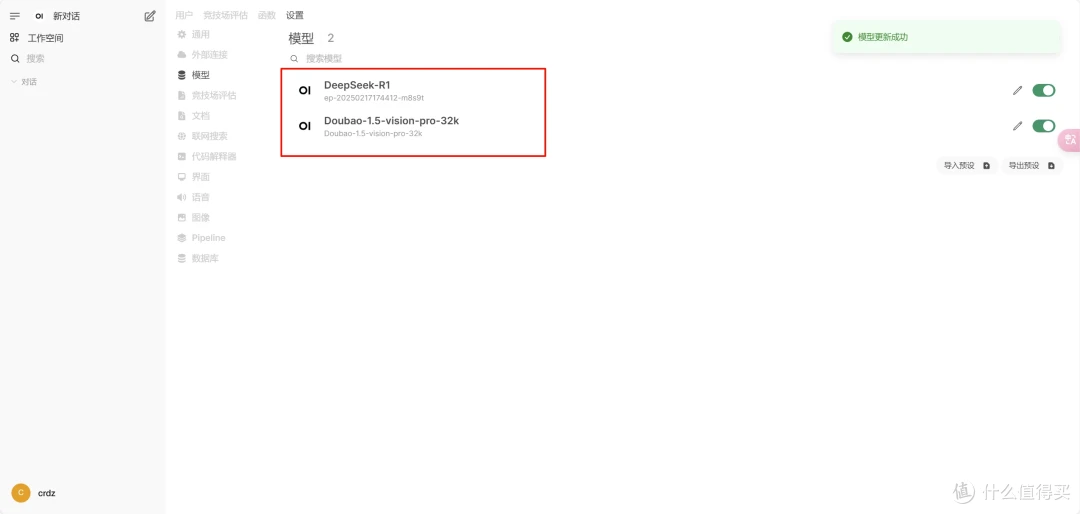

如果你需要添加火山方舟的其他模型只需要在模型里添加相应的模型名称就可以了,比如我又添加了一个豆包的

如果添加其他的提供商是同样的方法,硅基流动的模型可以为空,会自动把所有模型都添加上去。

模型如果添加多了都不知道哪个名称对应的是哪个,我们就需要修改一下名称让我们知道它是哪个模型

同样在管理面板的设置里找到模型,点击模型名称并修改,然后保存并更新

修改完成后

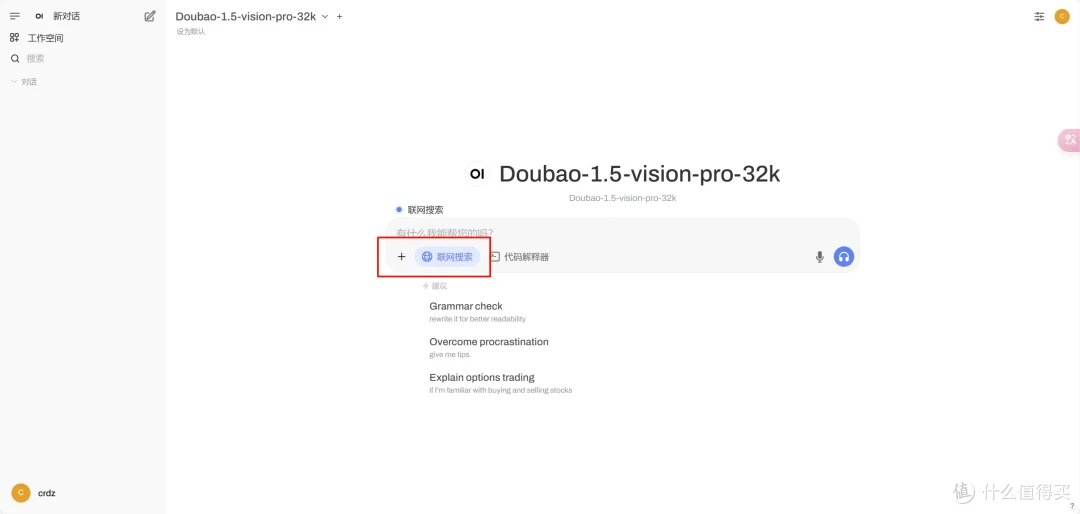

如果要添加联网搜索就在管理面板里把联网搜索打开,duckduckgo是不需要api的,tavily方法也比较简单,注册送1000次搜索,其他自行摸索

保存后就可以联网搜索了

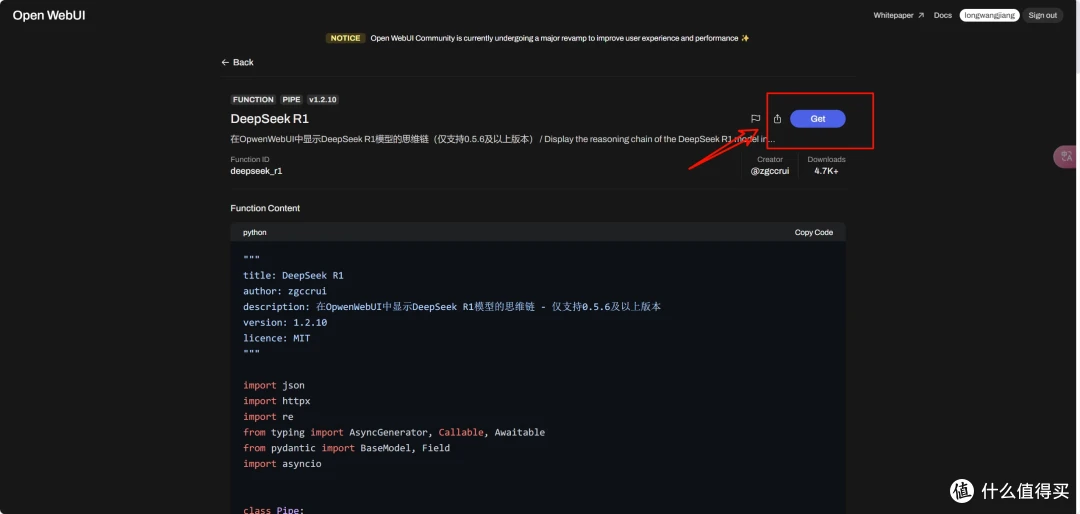

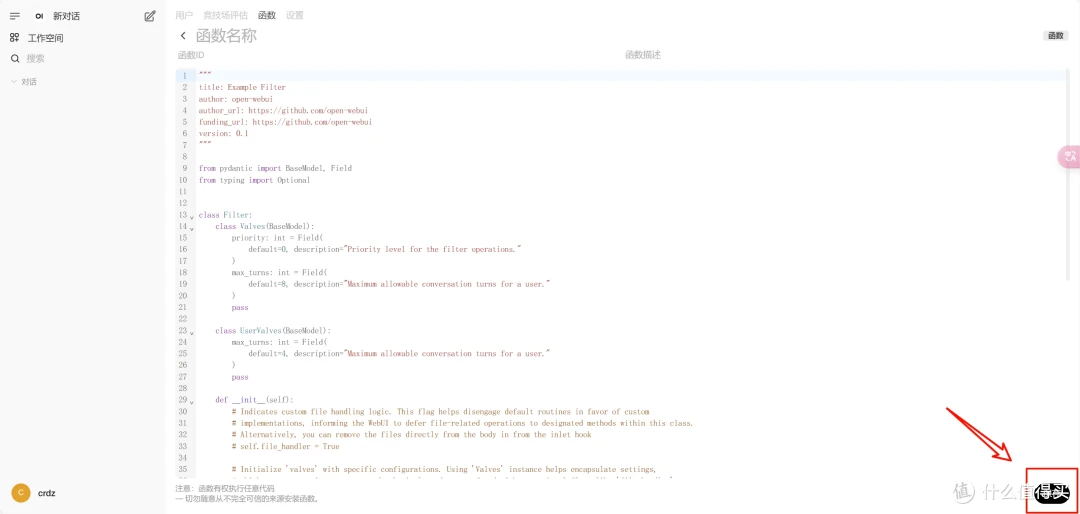

如果想要开启官网一样的思考模式那就需要导入函数了

首先打开链接注册一个账号:https://openwebui.com/f/zgccrui/deepseek_r1

点击Get

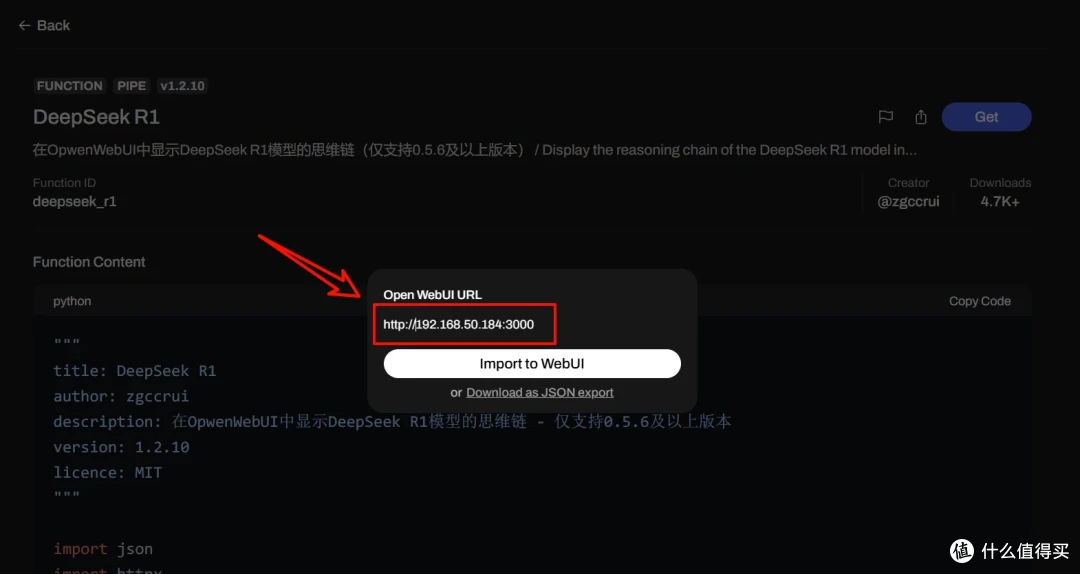

填写内网或者外网的访问Open WebUI的地址

点击Import to WebUI然后点保存,确认

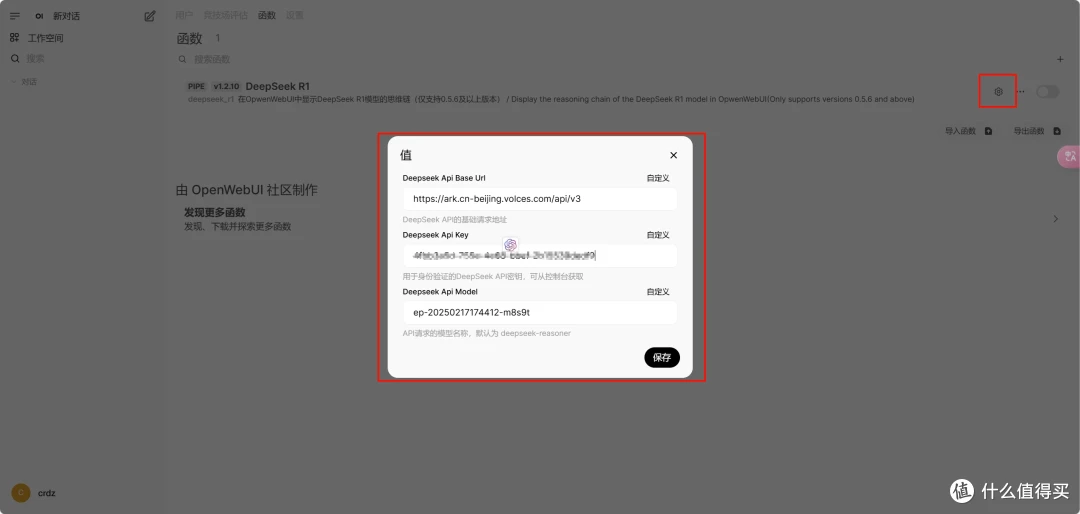

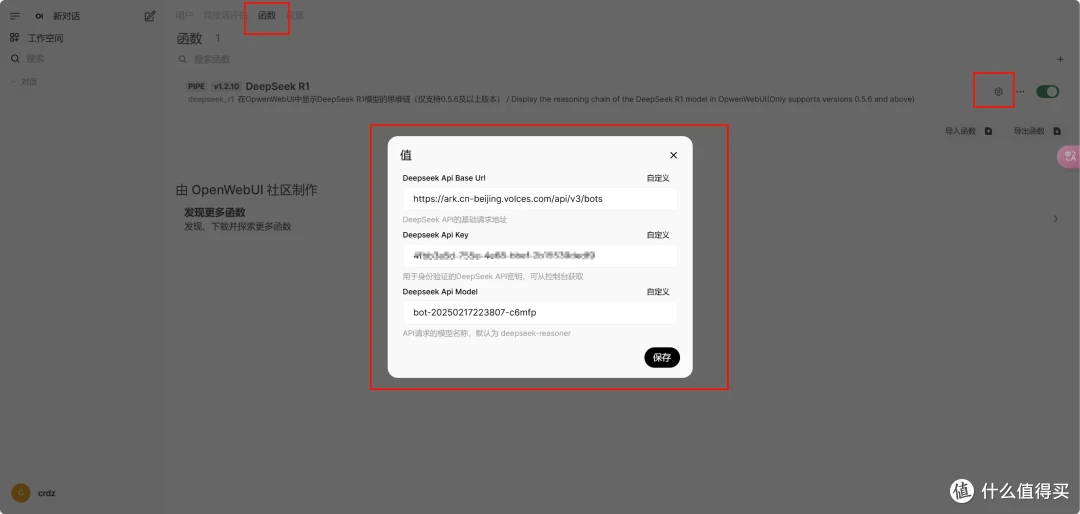

保存好后在页面的设置里填写URL API KEY和模型名称,然后保存

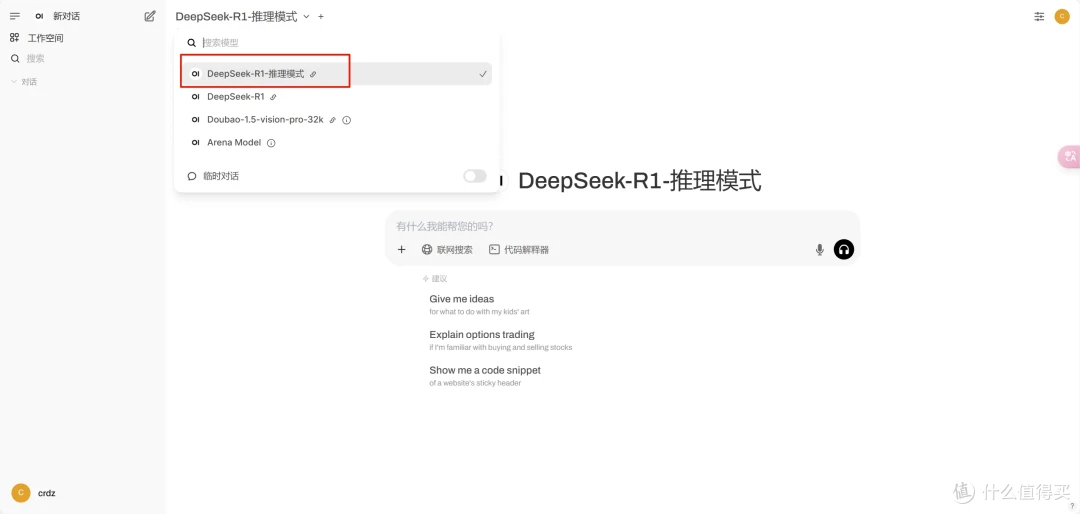

保存好以后修改一下带推理模型的名称,然后就可以问问题了

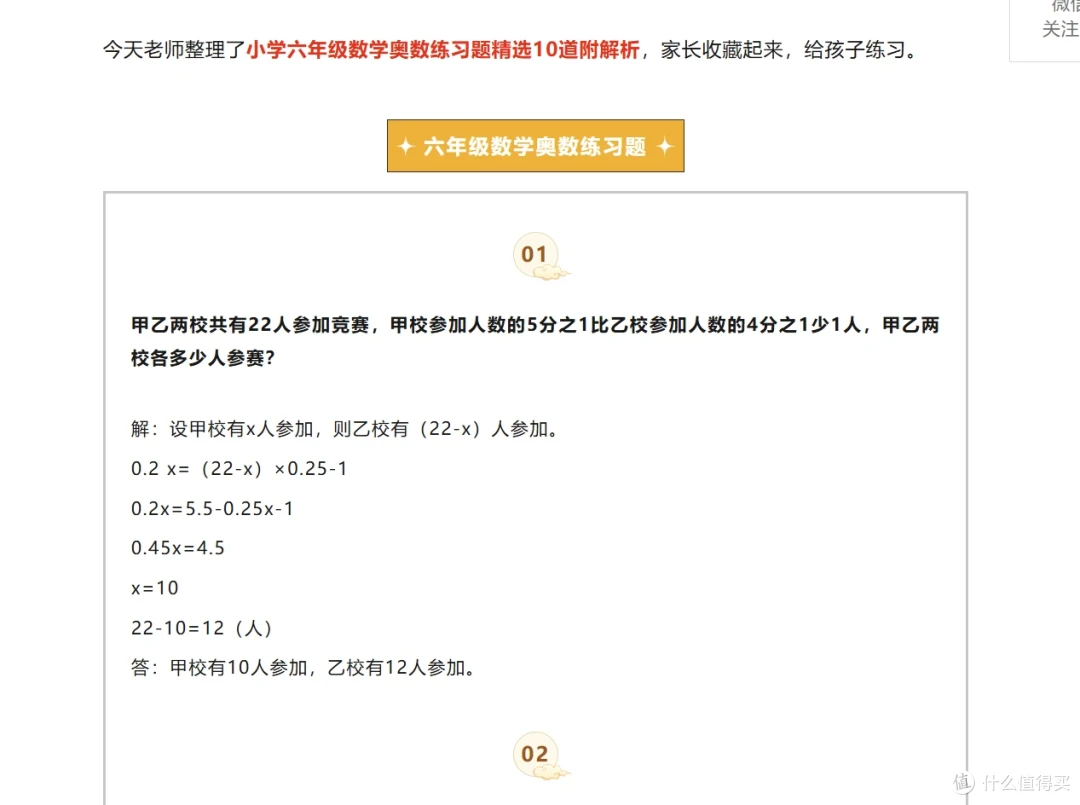

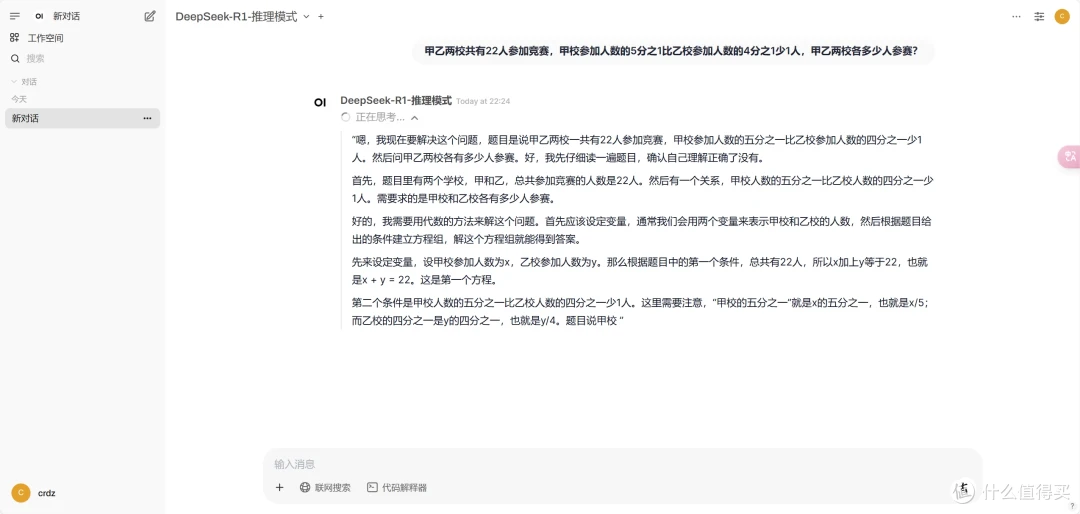

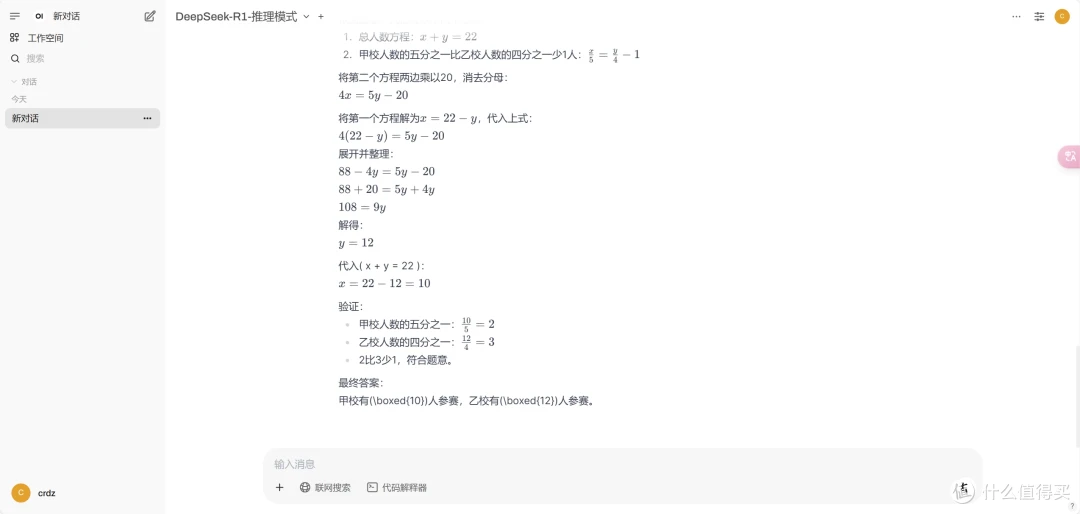

测试一下六年级奥数题目

思考中

答案正确,我们可以清晰的看到推理过程

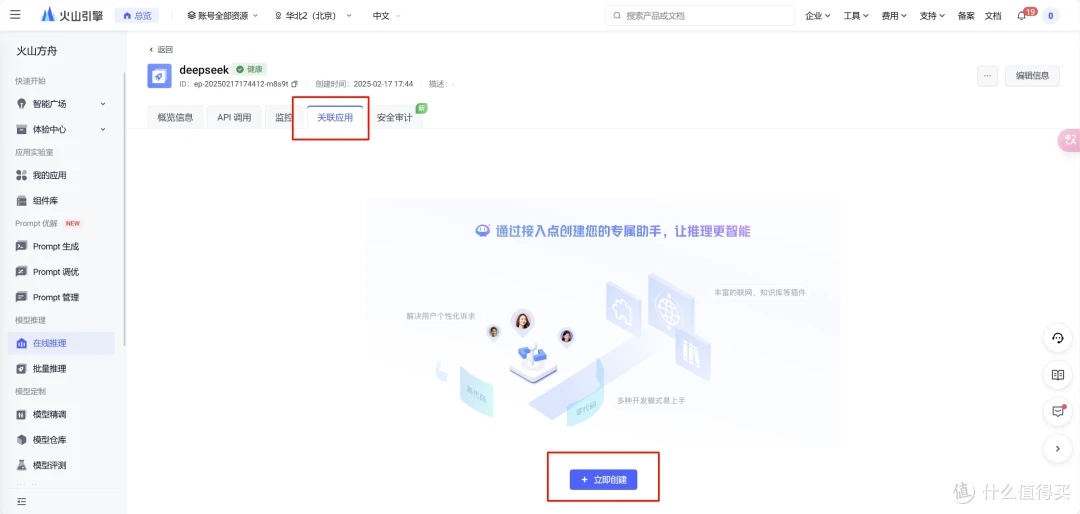

如果需要火山方舟自己的联网搜索并且带推理模式那就需要在控制台设置一下

打开在线推理-关联应用-立即创建

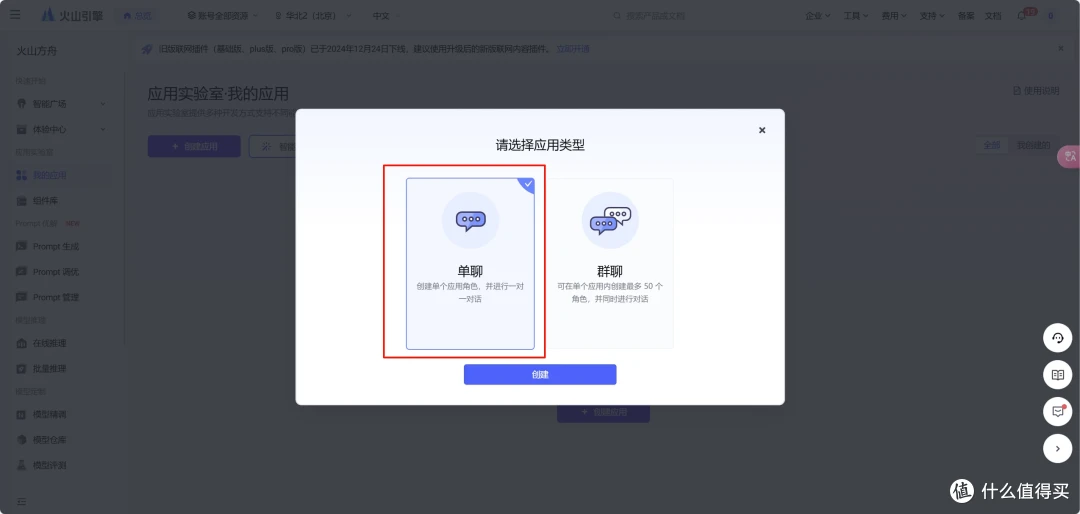

选择零代码

选择单聊模式

内容看着填

开通好以后打开联网,然后点发布

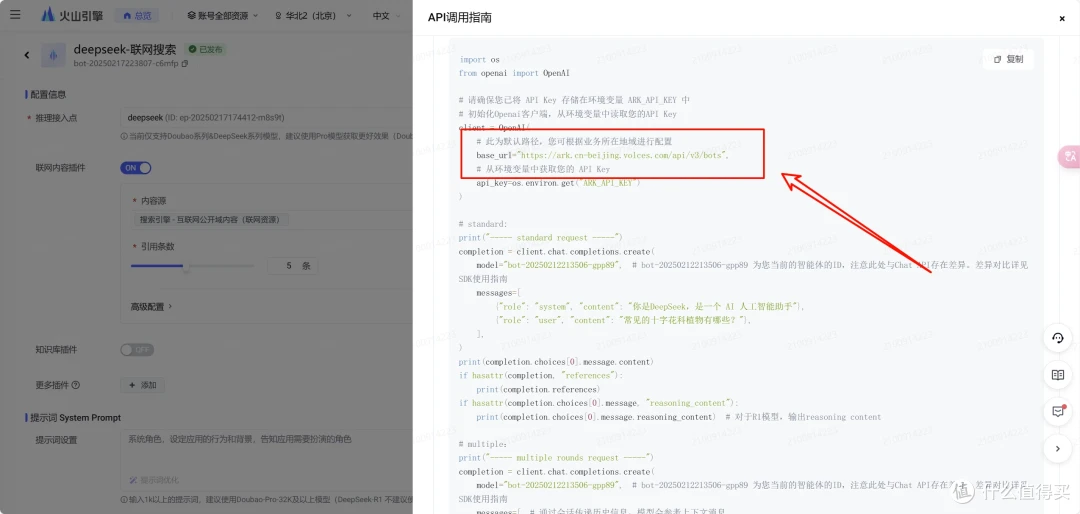

到这里就需要需改一下URL地址和模型名称了,这里可以很清楚的看到URL

后面带bot的这个就是URL地址

模型名称在这里

我们在函数里面修改URL和模型名称

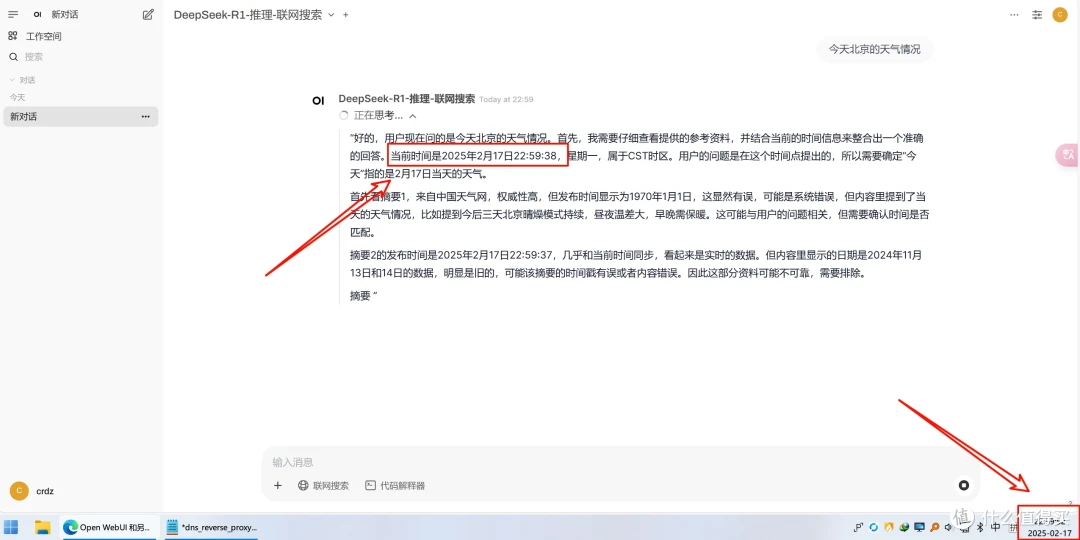

修改一下模型名称,这样就可以使用火山方舟的联网+推理了

同样的道理,火山方舟支持的其他模型也可以这么去操作